自動生成アルゴリズムによる音楽およびその音素材の設計には、慎重なパラメータの選択とコントロールを要します。

たとえばドローンのようなプリミティブな音の持続、ミニマル・ミュージックのような一定のパターンを記憶させたもの、あるいはイアニス・クセナキスが提唱した「確率音楽」といったものは、比較的シンプルなアルゴリズムによって実現が可能です。

対して、音楽がより「人間らしくある」ために厳密にデザインされるべきものとしては、以下が挙げられるでしょう。

- 音色の選択

- 音の響きのバランス

- 音ごとのゆれ

- 同一音の頻度、あるいはリズムの形成

- 特定の音の生成のきっかけ (入力パラメータ)

- 調子の変化のタイミングと方向性

これらの要素について、拙作の「絶えず流れる光: 緑」をまじえて、どのようなアプローチをとるべきかを考察したいと思います。

楽曲について

「絶えず流れる光: 緑」は、アルゴリズム音楽生成に特化したプログラミング環境であるSuperColliderを、さらにWave Field Synthesis環境に合わせて拡張したプラットフォーム「WFSCollider」を用いて制作された作品です。

SuperColliderのもともとの機能による音の生成・合成に加え、10メートル四方の空間内で自由に音像を動かす操作が可能になります。

内容は4分半程度のもので、何らかのデバイスによってリアルタイムに操作するのではなく、どのタイミングで何の音を使用するかはある程度あらかじめプログラムされています。

ただ、細かな音の再生のタイミングや音像の位置などには、確率によるランダム性が施されています。

音色の選択

コンピュータによる音楽制作では無制限とも言えるほどの種類の音色から選択することになり、それは楽曲全体の印象にも大きな影響を与えます。

今回は空間内で音を動かせるWave Field Synthesisという環境を活かすため、人工的なシンセの音というよりは、触覚や視覚によって質感を感じられるかのような音で構成することで遠近感を演出したいと考えました。

素材となる音は楽器音や環境音を元とし、それらを加工(ピッチシフト、フィルタリング、逆再生)して作成します。

- チェロの伸ばされた単一の音

- ピアノの伸ばされた単一の音

- チェレスタの単一の音

- ウィンドベルの音

- 大太鼓の音

- シンバルを擦る音

- 葉擦れの環境音

音の響きのバランス

一定の音域に複数の音が集中して重なりすぎてしまうと、響きの質は落ちてしまいます。

そのため、おおまかに低音域(200Hz程度まで)、高音域(1000Hz以上)、その中間域で考えてバランスを見ます。

特に高音域は気をつけるべきであり、この域で一つの音を伸ばし続けるのは聴取体験が不快なものとなってしまう恐れがあります。

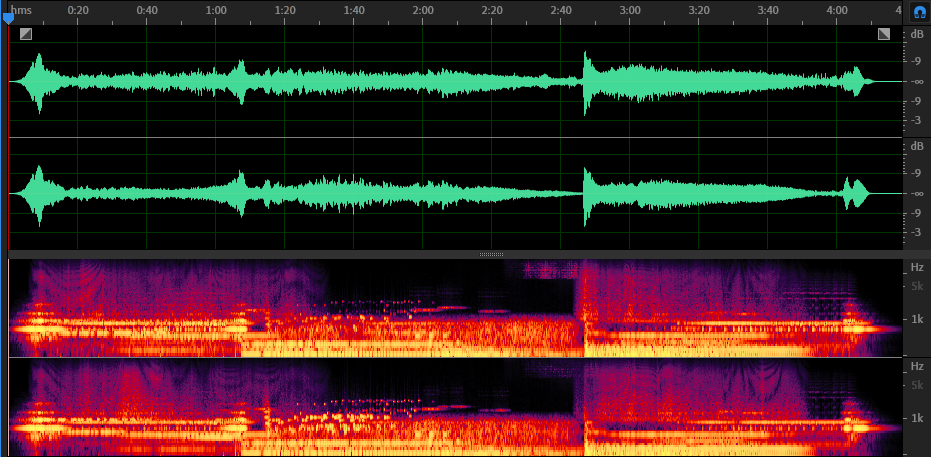

この図の下半分では、曲中でどの高さの音が現れているかがわかります。

重要な音は基本的に中間域にまとめながら、高音域には葉擦れやウィンドベルの音、低音域にはチェロの音をメインに据えて響きを支えています。

音ごとのゆれ

ゆれというのは、たとえば人間が楽器や声などで同じ音を繰り返すときに必ず現れる、ピッチや強さのわずかな差異です。

ゆれの無い音が繰り返されると、途端に「人間らしさ」は失われます。

この楽曲でもその嫌いは表出してしまってはいますが、強弱と音像の位置を音ごとにわずかに変えるという処理を施して機械的な印象の緩和を試みています。

他の対策としてはたとえば、一つの音を表現するためにより多くの音素材を用意したり、ピッチや発音後の音の揺らぎ(モジュレーション)を変えたりといった方法が考えられます。

同一音の頻度、あるいはリズムの形成

人間には、決まったパターンを見出す(聞き出す)精度が非常に高く、わずか3~4個の音が決まったタイミングで現れるだけでそこにリズムを感じ取ります。

ランダムに音を発生させるのは、面白い効果が得られる一方で、意図しないリズムを聴かせる恐れも同時にはらみます。先の〈音ごとのゆれ〉と合わせて、各音の発生の確率を丁寧に調整することが必要になります。

特定の音の生成のきっかけ (入力パラメータ)

今回の楽曲では、どのタイミングによってどの音を生成するかが前もって設計されていますが、よりコンピュータによる生成に任せたい場合、そのきっかけのパラメータは非常に多くの選択肢がありますし、インタラクティブなものを制作するのにも応用ができます。

入力パラメータには、以下のようなものが考えられます。

- 人の目や手などの(場合によってはマウスやコントローラーなどのデバイスを通じた)動き

- 一定の空間内の人の位置や密度

- カメラに写る色

- リアルタイムの様々なデータ: 気温、天気、湿度など

しかし私が重要だと考えるのは、この入力が人間にとって説得力のある形で音として出力されているか、特に心理的に入力と出力の関係性を感じられるかという部分です。

たとえば色を入力パラメータとして、白と同じスペクトルを持つ音としてホワイトノイズを対応させたり、高い周波数を持つ紫と可聴域限界に近い高音を対応させたりするのは、数値としては同じであるかもしれませんがそれ以上でもそれ以下でもありません。

最終的に、どの程度リスナーやパフォーマーにとってコントロールを可能にさせるかというところもデザインできるようにするために、入力と出力を丁寧につなげるのは重要なことだと考えます。

調子の変化のタイミングと方向性

その楽曲が持つ調子がどのくらい持続するべきなのか、そもそも調子は変化すべきかずっと同じものであるべきか、また変化すべきならどのタイミングなのか。

これは楽曲が聴かれるシチュエーションによって大きく変わるであろう要素だと考えられます。

今回の曲はコンサート形式で聴かれるものであったため、1分強ごとにメインでなり続ける音を大きく変えることで飽きや疲れを緩和しながら、曲の統一感を得るために「長く鳴り続ける低音付近のドローンと、ランダムにちらつく高音域付近の音」というスタイルは共通させています。

つまり、調子の変化はそのタイミングだけでなく、どのくらい遠くに(あるいは近くに)変化するかも関わってきます。

あまりに大きく変化しそのまま最初の調子に戻ることがなければ「統一感がない音楽」となり、逆にほとんど変化がわからないようなものは「退屈な音楽」となってしまうでしょう。

結び

私は器楽演奏のための音楽からアルゴリズムを用いた音楽へと、媒体こそ変えることはありましたが、制作する音は常に有機的なものを目指してきました。そのなかで、アルゴリズムによる音と音楽のデザインで核となるのは、いかにランダム性をコントロールするかではないかというのが、私の現在の答えです。